Pensées

Les 5 niveaux d'adoption de l'IA

3 mai 2026

Devant l'IA, nous ne sommes pas tous égaux. Certains poussent loin ce que d'autres effleurent. Cinq temps observés en formation et en mission, qui composent un cycle, pas une montée. Au cœur, une vérité dure : aucune compétence n'est jamais acquise.

Cinq niveaux d'adoption de l'IA, une montagne à gravir ?

Cinq temps pour maîtriser l'IA.

Un mardi matin de mars, à Clermont-Ferrand, dans une formation pour une dizaine de courtiers en prêt bancaire. Vingt ans de métier pour le plus ancien. Il ouvre son ordinateur, lance Excel, et installe sous nos yeux le plugin Claude. Il se tourne vers la salle, hésite une seconde, puis tape un prompt en langage courant : « Construis-moi un simulateur de prêt immobilier complet, avec tableau d'amortissement détaillé, mensualité ajustable, taux variable, durée modulable, coût total assurance comprise. » Quelques secondes. L'outil est là. Fonctionnel. Plus complet que celui qu'il achète chaque année à un éditeur spécialisé. Il regarde l'écran. Ses collègues regardent l'écran. Il finit par dire à voix basse : « Je viens de faire ça, ou c'est lui qui l'a fait ? »

La question mérite d'être entendue jusqu'au bout. Parce que ce courtier n'a pas appris à coder. Il n'a pas appris la programmation Excel avancée. Il n'a appris ni les fonctions financières de Microsoft, ni les structures conditionnelles, ni l'algorithme d'amortissement constant. Il a appris quelque chose d'autre. Il a appris à savoir-faire-faire. Et la question qu'il pose, sans en mesurer la portée, est exactement celle qui structure cet essai.

Qu'est-ce qu'on appelle une compétence, quand la machine, à la demande, est désormais capable de la convoquer pour vous ?

La compétence est fluide, il faut donc la gérer

Vous croyez apprendre. Vous retenez vos compétences pour le temps où vous en avez besoin.

L'intuition tenace est celle d'un cerveau-disque-dur. On y déposerait des savoir-faire, qui resteraient stockés intacts, accessibles à la demande. Cinquante ans de neurosciences cognitives racontent l'inverse. Le cerveau ne stocke rien à la manière d'un disque. Il maintient des circuits par l'usage, et les laisse s'éteindre dès que l'usage cesse.

Donald Hebb posait déjà le principe en 1949[1] : « When an axon of cell A is near enough to excite cell B and repeatedly takes part in firing it, some growth process or metabolic change takes place in one or both cells such that A's efficiency [...] is increased ». La formule popularisée par Carla Shatz est devenue mantra : neurons that fire together wire together. Son corollaire est moins répété, et pourtant tout aussi vrai : neurons that don't fire together drift apart. Les neurones qui cessent d'être activés ensemble se désolidarisent. La compétence qui n'est plus convoquée se défait.

Eric Kandel, dans les travaux qui lui ont valu le prix Nobel de médecine en 2000, a montré que la mémoire à long terme « results in the growth of new synaptic connections, a structural change that parallels the duration of behavioral memory »[2]. Une compétence qui dure n'est pas un fichier sauvegardé. C'est une architecture neuronale matérielle, qui doit être entretenue par l'usage pour subsister.

L'étude la plus probante de cette fluidité reste celle de Bogdan Draganski et son équipe, publiée dans Nature en 2004[3]. Vingt-quatre adultes ont appris à jongler trois balles pendant trois mois. Avant et après, leurs cerveaux ont été scannés en IRM. La matière grise dans les régions visuo-motrices avait significativement augmenté chez les apprenants, par rapport au groupe contrôle. Mais le résultat décisif est arrivé trois mois plus tard. Sans pratique, l'expansion de matière grise avait diminué, et beaucoup de participants ne savaient plus jongler. La compétence apprise s'était cérébralement effacée. Pas métaphoriquement, littéralement. Mesurée en millimètres cubes.

Le phénomène inverse a été quantifié à une échelle plus brutale par Lotfi Merabet, Alvaro Pascual-Leone et leur équipe, en 2008[4]. Cinq jours suffisent pour reconfigurer un cortex visuel privé de stimulation : des sujets bandés des yeux pendant cinq jours voient leur cortex visuel se mettre à traiter du toucher. Vingt-quatre heures après le retrait du bandeau, la reconfiguration s'efface. Le cerveau humain est en renégociation permanente avec son usage. C'est son état normal, pas une exception pathologique.

Aucune compétence ne dort intacte. Elle vit, elle s'use, elle s'éteint.

Si tel est le cas, alors la question pratique du travail intellectuel change de nature. Maintenir en soi toutes les compétences dont on pourrait avoir besoin n'est pas seulement coûteux, c'est cérébralement impossible. Le cerveau humain doit choisir ce qu'il garde, ce qu'il laisse glisser, ce qu'il rappellera quand le besoin viendra. Gérer la fluidité de ses compétences est devenu un impératif neurobiologique, pas seulement un confort professionnel.

Existerait-il un outil capable de tenir, à la demande, ce que le cerveau ne peut plus garder intégralement ? La question est tentante, mais ce n'est pas la bonne. Avant l'outil, vient la capacité de l'individu à arbitrer ce qu'il garde et ce qu'il laisse glisser. Pas une compétence de plus à apprendre. Une compétence d'un autre ordre, qui gouvernerait toutes les autres.

Une compétence d'un autre ordre

Une compétence ne suffit plus. Il en faut une qui gouverne toutes les autres.

Rappelez-vous notre courtier de Clermont-Ferrand. Ce qu'il a mobilisé sans le savoir, ce qu'il commence à maîtriser sans en avoir le vocabulaire, c'est ce que la recherche en sciences du travail appelle, depuis trente-cinq ans, une méta-compétence. Le terme apparaît en 1989 sous la plume de John Burgoyne, dans le contexte du Management Charter Initiative britannique[5]. Burgoyne distingue les compétences classiques, qui permettent d'exécuter des tâches précises, d'une catégorie supérieure de capacités qu'il appelle « the overarching ability under which competence shelters ». La capacité surplombante sous laquelle les compétences s'abritent.

Reva Berman Brown, en 1993, donne au concept sa formulation canonique[6]. La méta-compétence, écrit-elle, embrasse les capacités d'ordre supérieur qui permettent d'apprendre, de s'adapter, d'anticiper et de créer. Elle ajoute, deux ans plus tard, une formule devenue référence :

Meta-competence can be learned but cannot be taught.

Elle peut être apprise, elle ne peut pas être enseignée. Pas par un cours. Pas par un manuel. Elle se construit dans l'usage, dans la pratique réflexive, dans l'expérience accumulée.

Françoise Le Deist et Jonathan Winterton, en 2005, organisent ce vocabulaire dans une typologie devenue le cadre européen de référence[7]. Quatre dimensions de la compétence : cognitive, fonctionnelle, sociale, et méta. Cette quatrième dimension est positionnée explicitement comme ce qui « facilite l'acquisition des trois autres ». Une compétence de second ordre. Qui ne résout pas un problème, mais modifie la capacité même d'en résoudre.

Cette définition croise précisément la tradition de Donald Schön, qui démontrait dès 1983 que la compétence professionnelle n'est pas un savoir stocké que l'on déploie, mais un knowing-in-action, un savoir-en-action qui se reconstruit à chaque situation, parce que les situations professionnelles sont toujours « uncertain, unique, unstable, and conflicting »[8]. Et la mesure brute de la dégradation a été établie de longue date : la méta-analyse de référence sur la perte de compétence, conduite par Winfred Arthur et son équipe en 1998 sur 189 points de données, montre un coefficient d'effet de -1,4 après 365 jours de non-pratique[9]. En clair : un an sans utiliser une compétence apprise, et la performance retombe à un niveau qui équivaut presque à n'avoir jamais appris. Ce que les neurosciences observent en IRM, la psychologie du travail le mesure en performance.

Une méta-compétence ne fait pas faire. Elle décide ce qu'on a besoin de savoir faire.

C'est la définition à tenir en main pour la suite. Une compétence classique permet d'écrire un email, de calculer une mensualité, de rédiger un compte rendu. Une méta-compétence permet de décider ce qu'on veut écrire, calculer, rédiger, et de mobiliser les ressources internes ou externes pour y parvenir. Elle gouverne. Elle ne produit pas, elle oriente la production. Et elle a, parmi ses fonctions principales, une que personne n'avait nommée en ces termes : arbitrer la fluidité des compétences. Décider lesquelles maintenir en soi, lesquelles laisser à portée sans les retenir, lesquelles convoquer à la demande quand le moment vient.

L'IA générative répond au critère

L'IA n'est pas une compétence de plus. Elle ouvre toutes les autres.

Aux 2 Alpes, en formation, une chargée d'accueil compose, avec une IA musicale, une chanson originale pour aider sa fille de trois ans à ranger sa chambre. Elle n'a jamais étudié la musique. À Lyon, deux membres du CODIR de Suez rédigent en vingt minutes des notes contractuelles qu'ils sous-traitaient à un cabinet juridique. À Paris, un particulier décortique sa propre proposition d'assurance habitation, mention légale par mention légale, et demande à la machine où sont les pièges. À Clermont, le courtier code son simulateur. Tous, sans exception, ont produit une chose qu'ils n'auraient jamais produite seuls. Aucun n'a appris la compétence avant. C'est la compétence qui est venue à eux, par la machine, à la demande.

L'observation, répétée des centaines de fois en mission et en formation, est désormais corroborée par les études les plus rigoureuses. Zhicheng Lin et Aamir Sohail, dans la revue Patterns du groupe Cell, l'écrivent en janvier 2026[10] dans une formule frappante de justesse :

GenAI can perform the foundational intellectual activities through which expertise itself develops: reading literature, designing studies, writing arguments, and generating code.

L'IA générative exécute les activités intellectuelles fondamentales par lesquelles l'expertise elle-même se développe. Toutes les compétences qui passent par l'écriture, qui forment la part dominante du travail tertiaire, lui sont accessibles. Le code. La traduction. La recherche académique. La communication. La stratégie. La synthèse. La rédaction de contrats. La revue de littérature. L'analyse de propositions commerciales.

Les chiffres adossent ce constat. Erik Brynjolfsson, Danielle Li et Lindsey Raymond ont mesuré sur 5 179 agents de service client une amélioration moyenne de productivité de +14%, qui monte à +34% chez les novices[11]. L'effet est égalisateur : l'IA diffuse les meilleures pratiques des plus compétents vers les nouveaux. Fabrizio Dell'Acqua, Ethan Mollick et leurs collègues ont observé sur 758 consultants du Boston Consulting Group des gains de +12,2% de tâches complétées, 25% plus vite, avec une qualité supérieure de +40%[12]. Les développeurs équipés de GitHub Copilot, dans une expérience contrôlée de Microsoft sur près de 2 000 ingénieurs, gagnent entre +12% et +22% de pull requests par semaine[13]. Concrètement, un ingénieur produit en quatre jours ce qu'il faisait en cinq, sans changer de poste, sans formation supplémentaire, sans avoir attendu que la hiérarchie l'autorise. L'IA ne crée pas la compétence à partir de rien, elle la rend accessible à la demande. Il faut juste, pour cela, en maîtriser le levier.

Maîtriser l'IA, c'est arbitrer en permanence : ce que je garde en moi, parce que j'en ai besoin tous les jours, et ce que je laisse à portée de prompt, parce que je n'en ai besoin qu'au moment précis où je le sollicite.

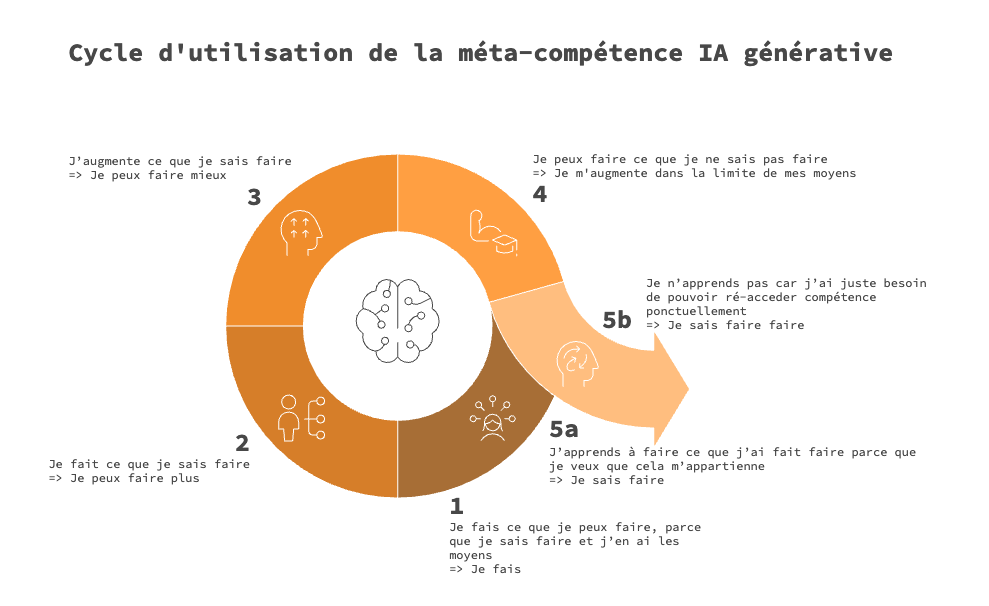

Le cycle, en cinq temps

Vous croyez monter. Vous tournez. Et chaque tour vous augmente.

Les modèles classiques d'adoption technologique, depuis Everett Rogers en 1962, décrivent une diffusion en pente. Les innovateurs adoptent en premier, suivis des adopteurs précoces, puis de la majorité, et enfin des retardataires. Ces modèles fonctionnent pour décrire la pénétration d'un produit dans une population. Ils ne disent rien de ce qui se passe à l'intérieur d'un individu qui s'approprie la méta-compétence. Trois années d'observation directe, en formation comme en mission, font apparaître autre chose. Pas une pente. Un mouvement qui revient sur lui-même et élargit, à chaque tour, le périmètre du faisable.

Cinq temps, donc. Cinq, mais en boucle. Et chacun mérite d'être déplié, parce que chacun met en jeu une dynamique propre, des accélérateurs, des freins, et un déclencheur qui fait passer au suivant, ou pas.

Temps un, je fais ce que je peux faire

Le moteur de recherche, en mieux. Vous êtes encore au seuil.

Le point de départ. L'utilisateur fait ce qu'il a toujours fait, avec les outils qu'il a toujours eus. L'IA est entrée dans sa vie, mais comme un moteur de recherche un peu plus malin. Il lui demande la définition d'un terme, l'explication d'un concept, la traduction d'une expression. La machine répond, l'utilisateur recopie. Rien d'autre ne change.

L'étude économique d'OpenAI publiée en septembre 2025 donne la mesure de ce premier temps[14]. Sur 1,1 million de messages échangés avec ChatGPT, les chercheurs ont identifié une catégorie qu'ils appellent Asking : demander à la machine une information ou une explication. Cette intention représente 49% des conversations.

Lecture importante de ce chiffre. Il ne dit pas que la moitié des utilisateurs ne font que ça. Il dit que la moitié des prompts émis sont de cet ordre. Le même utilisateur peut, dans la même journée, poser une question d'orthographe et lancer ailleurs un projet plus ambitieux. Le cycle décrit des registres d'usage, pas des catégories d'utilisateurs.

Ce qui retient au temps un, c'est rarement un manque d'intelligence. C'est un frein représentationnel, comme je le constate dans presque chaque session d'initiation. La machine est perçue comme oracle, comme entité, comme intelligence supérieure qui décide. Tant que cette représentation tient, l'utilisateur reste demandeur, jamais auteur. Ce qui débloque, c'est l'exposition à des cas d'usage simples qui désamorcent la magie. La machine cesse d'être oracle. Elle devient outil. L'utilisateur peut alors avancer.

Temps deux, je fais ce que je sais faire

Vous gagnez du temps. Vous ne gagnez pas encore d'autonomie.

L'IA entre dans le tableau, mais comme un assistant. Elle accélère ce que l'utilisateur faisait déjà. Compte rendu de réunion à partir de notes brutes. Email de relance à un client qui ne répond pas. Synthèse d'un rapport trop long. Traduction d'un mémo. L'utilisateur reste maître de l'objet, la machine en accélère la production. Mêmes tâches, plus vite. Le périmètre du faisable s'élargit en volume, pas en nature.

Dans l'étude OpenAI, cette intention s'appelle Doing. Elle représente 40% des conversations. Combinée à Asking, elle couvre près de 90% des usages mesurés.

Ce qui retient au temps deux, c'est une combinaison de routine et de satisfaction installée. L'utilisateur a déjà gagné du temps, ce qui suffit à justifier l'effort d'apprentissage initial. Il ne va pas plus loin parce qu'il ne voit pas pourquoi aller plus loin. Le déclencheur du passage au temps trois, à ce stade, est presque toujours externe. Une démonstration vue chez un collègue. Un usage personnel qui surprend, le soir, à la maison. Une chanson composée en deux minutes pour ranger une chambre. Une recette adaptée à un régime particulier. Le déclencheur n'est jamais professionnel. Il vient toujours de l'autre sphère.

Cette dimension est centrale et trop peu nommée. La profondeur d'usage de l'IA est interdépendante entre la sphère personnelle et la sphère professionnelle, c'est ce que la littérature en systèmes d'information appelle depuis Aurélie Leclercq-Vandelannoitte la reversed IT adoption logic[15]. Les collaborateurs transfèrent leur expérience des technologies personnelles vers le lieu de travail. Avec l'IA générative, ce transfert est qualitativement plus profond que tout ce qu'on a connu jusque-là. Ce n'est plus un appareil qu'on apporte au bureau. C'est une capacité cognitive augmentée qui s'installe partout.

Temps trois, j'augmente ce que je sais faire

Vous ne demandez plus. Vous ne faites plus faire. Vous pensez avec.

L'utilisateur ne se contente plus d'aller plus vite. Il fait mieux, ou autrement. Il découvre que l'IA améliore aussi la qualité, la précision, la clarté. Il pense avec. Il dialogue. Il reformule, il fait reformuler, il argumente contre ses propres idées en les soumettant à la machine. L'analyse stratégique gagne en finesse. La note de synthèse gagne en structure. La proposition commerciale gagne en cohérence.

Dans l'étude OpenAI, cette intention s'appelle Expressing. Elle représente 11% des conversations. C'est, statistiquement, le seuil où la méta-compétence devient active. L'utilisateur ne demande plus, ne fait plus faire. Il pense avec.

Le passage du temps deux au temps trois est un seuil. Et ce seuil est traversé par un profil récurrent que je rencontre dans presque chaque organisation où une demande de formation à l'IA est formulée. Un catalyseur, presque toujours unique. Curiosité élevée, propension à tester, mal-être plus marqué face à la procéduralisation de son métier. Ce profil correspond exactement à ce que la psychologie du travail appelle depuis Bateman et Crant la personnalité proactive, et à ce qu'Amy Wrzesniewski et Jane Dutton ont théorisé sous le nom de job crafting[16] : la capacité, bottom-up, à redéfinir les frontières de son propre poste pour l'aligner sur ses préférences et ses besoins.

Le concept que je nomme BYOA, Bring Your Own AI, et que BYOA, ce que les employés font sans permission développera en essai dédié, n'est pas autre chose qu'un acte de job crafting technologiquement armé. Le catalyseur ne se contente pas de redéfinir mentalement son poste. Il automatise concrètement les parties procédurales et s'attribue les parties signifiantes. Et c'est précisément à ce moment qu'il bascule dans le temps trois.

Temps quatre, je peux faire ce que je ne sais pas faire

Vous franchissez votre frontière. Sans diplôme. Sans permission.

C'est la bascule. L'utilisateur sort de son périmètre initial. Le courtier en prêt bancaire qui code un simulateur Excel sans avoir appris à coder. La chargée d'événementiel qui construit un tableau de bord sans avoir suivi de formation BI. Le particulier qui décortique sa proposition d'assurance ligne par ligne sans avoir fait de droit. Le responsable RH qui rédige une analyse juridique fine sur un cas de licenciement sans avoir fait de droit du travail. La méta-compétence est à l'œuvre, frontalement.

Ce temps n'est pas isolable dans les chiffres OpenAI, parce que le volume statistique ne le permet pas encore. Ces usages restent très minoritaires, mais ils se développent vite, et l'observation terrain le confirme, partout, toutes les semaines. Les études contrôlées le mesurent indirectement. Quand Iavor Bojinov et son équipe à Harvard observent +67% de gain de temps en conceptualisation et +74% en rédaction sur des tâches dont l'utilisateur n'avait pas l'expertise initiale[17], c'est exactement ce temps qu'ils mesurent. Avec une nuance honnête : l'IA fournit la carte, naviguer le terrain demande encore une expérience que la machine ne donne pas. Le temps quatre n'abolit pas l'expertise domaine, il étend le périmètre de ce que l'utilisateur peut entreprendre seul.

Ce qui retient au passage du temps trois au temps quatre, c'est presque toujours un frein de représentation de soi, plus qu'un frein cognitif. La phrase qui revient en formation est invariable : « ce n'est pas mon métier ». Elle est rarement vraie. Elle est presque toujours l'écho d'un habitus, au sens de Bourdieu, qui a tracé les contours du possible avant toute délibération consciente. Le courtier de Clermont, avant son simulateur, aurait juré que coder n'était pas son métier. Il a appris, en quelques minutes, que c'était devenu son métier sans qu'il l'ait demandé.

Et c'est ici que survient un phénomène que je n'ai vu nommé nulle part dans la recherche, mais qui mérite un nom : le choc de la démonstration. Des participants intéressés, qui perçoivent le potentiel de la machine, se retrouvent en surcharge cognitive. Forte émotion, refus de pratiquer, rejet en bloc. Quand on peut trop d'un coup, on ne veut plus. Le système se verrouille au lieu de s'ouvrir. C'est le contrepoint sombre du mécanisme que Quand on peut, on veut décrit dans son versant lumineux. La méta-compétence se gagne aussi par dosage.

Temps cinq, la bifurcation

Vous avez fait. Reste à choisir ce qui est à vous.

Le moment décisif du cycle n'est pas le temps quatre. Le moment décisif est ce qui suit. Parce que c'est là qu'on retrouve un réflexe ancien, profondément ancré dans la culture du travail moderne. Le réflexe d'internaliser. L'idée qu'une compétence n'est vraie que si elle est intégrée, possédée, retenue.

Cette croyance est l'héritage direct d'une économie de la rareté du savoir. Quand l'accès à la connaissance était lent, coûteux, contrôlé par les institutions, alors il fallait apprendre tout ce qui passait à portée. Ce qu'on n'apprenait pas, on le perdait. Cette ère est terminée. Et le cycle, à son cinquième temps, en prend acte.

Temps cinq-a. J'apprends à faire ce que j'ai fait faire, parce que je veux que cela m'appartienne. Le courtier de Clermont décide de comprendre comment son simulateur Excel fonctionne. Il étudie les fonctions financières que la machine a mobilisées. Il s'approprie la logique de l'amortissement constant. La compétence devient sienne, internalisée. Elle reste avec lui, même si la machine s'éteint. Cette voie est rationnelle pour les compétences dont il aura besoin de manière régulière, parce que l'usage répété justifie l'effort d'intégration.

Temps cinq-b. Je n'apprends pas, parce que j'ai juste besoin d'y revenir quand il le faudra. Le même courtier décide qu'il n'a pas besoin de comprendre, parce qu'il sait qu'il pourra refaire générer le simulateur en deux minutes la prochaine fois qu'un client le demandera. Il opère un choix rationnel. Il n'est pas paresseux. Il économise une ressource cognitive limitée pour la consacrer à autre chose. Ce qu'il garde, c'est la méta-compétence, la capacité à faire-faire. Ce qu'il ne s'encombre pas de retenir, c'est le détail. Cette voie est rationnelle pour les compétences ponctuelles, ou pour celles qui s'actualisent à intervalle régulier. La déclaration de revenus, qu'on fait une fois par an et dont les règles changent à chaque mouvement fiscal. Le référencement naturel, le pilotage des réseaux sociaux, la veille des algorithmes qui se reconfigurent en permanence. Ces compétences ne valent pas l'effort d'internalisation, parce que le temps de leur maintien dépasserait celui de leur stabilité. Faire-faire est plus efficient que faire.

Une compétence n'a pas besoin d'être en vous pour être à vous.

L'idée heurte. Elle heurte parce qu'elle contredit cinq décennies de pédagogie de l'effort, de gestion par les compétences, de carte des savoir-faire individuels. Pourtant, elle est cohérente avec ce que les sciences cognitives appellent depuis Evan Risko et Sam Gilbert le cognitive offloading, l'externalisation cognitive[18]. Écrire une note pour ne pas avoir à mémoriser. Utiliser une calculatrice pour ne pas avoir à calculer. Demander à une IA pour ne pas avoir à rédiger. Le principe est le même. Le degré change.

Il faut ajouter une nuance qui désamorce la fausse opposition entre cinq-a et cinq-b. Le mouvement entre les deux est réversible. Une compétence apprise peut, par non-utilisation, redescendre en cinq-b, parce que les neurosciences l'ont démontré au scanner. Le courtier qui aura compris les fonctions financières d'Excel mais ne les aura pas pratiquées pendant trois ans les aura partiellement perdues. Il devra revenir à la machine pour refaire faire. Sa compétence cinq-a sera redevenue cinq-b. Inversement, une compétence longtemps en cinq-b peut basculer en cinq-a le jour où l'utilisateur décide de l'intégrer, parce qu'il en a désormais un usage régulier qui justifie le coût cognitif d'apprentissage. Le mouvement n'est pas figé. La fluidité de la compétence implique aussi celle de la décision d'internaliser ou pas.

Le critère décisif n'est pas l'internalisation. C'est la disponibilité.

Cette inversion est l'enjeu réel de l'essai. Aussi longtemps que la compétence est disponible, en soi ou en externe, le sujet peut agir. Et c'est l'agir qui compte, pas la possession. La conscience que la compétence est accessible débloque le désir d'entreprendre. C'est le mécanisme cognitif que Quand on peut, on veut développe en détail.

Et le cycle, ensuite, repart au temps un. Plus précisément, à un nouveau point de départ, parce que la zone du faisable s'est étendue. Le cycle reprend, sur un terrain plus vaste. Et c'est ce mouvement, répété, accumulé, qui constitue la méta-compétence vivante.

L'usage, sous condition

Vous pouvez tout faire avec l'IA. Vous ne pouvez pas le faire n'importe comment.

Tout ce qui précède repose sur une condition que je n'ai pas encore nommée. Que l'usage de l'IA soit régulé. Pas brut. Pas aveugle. Pas magique. Sans cette régulation, le cycle se grippe, le cinq-b devient déqualification, et la méta-compétence promise se défait au lieu de se construire.

Le risque est mesuré, et il serait malhonnête de le masquer. L'équipe de Microsoft Research, dans une étude présentée à la conférence CHI en 2025, a observé sur 319 knowledge workers et 936 cas d'usage que la confiance accordée à la machine corrèle négativement avec la mobilisation de la pensée critique[19]. Plus l'utilisateur fait confiance, moins il vérifie. Plus il s'en remet, plus il se déqualifie.

Mal utilisée, l'IA défait ce qu'elle promettait d'augmenter.

À l'inverse, Zhicheng Lin et Aamir Sohail, dans la même publication de Patterns citée plus haut, identifient trois capacités à cultiver explicitement pour que l'IA tienne sa promesse[10]. La direction stratégique, savoir formuler une intention claire qui guide la machine au lieu de la laisser dériver. Le discernement critique, savoir évaluer la sortie, repérer une hallucination, peser ce qui mérite vérification. La calibration systématique, savoir quand accepter, quand éditer, quand rejeter. Avec ces trois capacités, le cinq-b devient une stratégie d'allocation cognitive parfaitement légitime, et le cinq-a une vraie appropriation. Sans elles, le cinq-b devient déqualification métacognitive, et le cinq-a un faux apprentissage qui n'aura été que de la copie.

Cet usage régulé n'est pas accessoire. Il est le seuil qui sépare l'augmentation réelle de l'illusion d'usage. Et il mérite à lui seul une Audace dédiée, IA générative, votre usage est-il un bon usage ?.

Ce qui se joue à l'échelle des organisations

Refuser l'IA dans une entreprise, vous croyez préserver. Vous appauvrissez.

Si maîtriser l'IA générative est une méta-compétence, alors les organisations qui en restreignent l'accès, par défiance, par lenteur d'arbitrage, par crainte juridique, ne se contentent pas de priver leurs collaborateurs d'un outil. Elles bloquent leur accès à la méta-compétence elle-même. Et puisque cette méta-compétence est le levier de toutes les autres, l'effet net est une amputation de leur capacité à se former, à s'adapter, à se reconcevoir.

celui qui n'a pas accès à l'IA générative ne perd pas une compétence, il perd la capacité d'en acquérir d'autres

À chaque tour de cycle évité, son périmètre du faisable se réduit relativement à celui de ses pairs équipés.

les organisations qui restreignent ne préservent pas leur structure, elles installent une inégalité durable entre celles qui équipent et celles qui freinent

Le rapport de force change non par effet d'échelle, mais par cumul silencieux de méta-compétences chez ceux qui y ont accès.

Le phénomène n'est pas une projection. Il est en cours, tous les jours, dans les bureaux où les salariés contournent leur employeur en utilisant l'IA sur leur ordinateur personnel ou leur téléphone. C'est précisément ce que La révolution qui n'a pas eu lieu décrit, et que BYOA, ce que les employés font sans permission traitera frontalement.

Le frein n'est pas cognitif. Il est organisationnel. Et il est, à l'échelle des entreprises, exactement ce que la peur d'apprendre est à l'échelle d'un individu : un refus de boucler le cycle.

Si la compétence n'a plus besoin d'être en vous pour être à vous, qui décide encore de ce qu'on appelle savoir ?

Sources

- Donald O. Hebb, The Organization of Behavior: A Neuropsychological Theory, Wiley & Sons, 1949.

- Eric R. Kandel, « The Molecular Biology of Memory Storage: A Dialogue Between Genes and Synapses », Science, vol. 294, n° 5544, 2001.

- Bogdan Draganski, Christian Gaser, Volker Busch, Gerhard Schuierer, Ulrich Bogdahn & Arne May, « Neuroplasticity: Changes in grey matter induced by training », Nature, vol. 427, n° 6972, 2004.

- Lotfi B. Merabet, Roy Hamilton, Gottfried Schlaug et al., « Rapid and reversible recruitment of early visual cortex for touch », PLoS ONE, vol. 3, n° 8, 2008.

- John Burgoyne, « Creating the managerial portfolio: building on competency approaches to management development », Management Education and Development, vol. 20, n° 1, 1989.

- Reva Berman Brown, « Meta-competence: a recipe for reframing the competence debate », Personnel Review, vol. 22, n° 6, 1993.

- Françoise Delamare Le Deist & Jonathan Winterton, « What is competence? », Human Resource Development International, vol. 8, n° 1, 2005.

- Donald A. Schön, The Reflective Practitioner: How Professionals Think in Action, Basic Books, 1983.

- Winfred Arthur, Winston Bennett, Pamela Stanush & Theresa McNelly, « Factors that influence skill decay and retention: A quantitative review and analysis », Human Performance, vol. 11, n° 1, 1998.

- Zhicheng Lin & Aamir Sohail, « Recalibrating academic expertise in the age of generative AI », Patterns (Cell Press), vol. 7, n° 1, 2026.

- Erik Brynjolfsson, Danielle Li & Lindsey Raymond, « Generative AI at Work », The Quarterly Journal of Economics, vol. 140, n° 2, 2025.

- Fabrizio Dell'Acqua, Edward McFowland III, Ethan Mollick et al., « Navigating the Jagged Technological Frontier », Organization Science, 2025.

- Zheyuan Kevin Cui, Mert Demirer, Sonia Jaffe et al., « The Effects of Generative AI on High-Skilled Work: Evidence from Three Field Experiments with Software Developers », Management Science (in press), 2025.

- Aaron Chatterji, Thomas Cunningham, David J. Deming et al., « How People Use ChatGPT », NBER Working Paper No. 34255, septembre 2025.

- Aurélie Leclercq-Vandelannoitte, « Managing BYOD: How do organizations incorporate user-driven IT innovations? », Information Technology & People, vol. 28, n° 1, 2015.

- Amy Wrzesniewski & Jane E. Dutton, « Crafting a job: Revisioning employees as active crafters of their work », Academy of Management Review, vol. 26, n° 2, 2001.

- Luca Vendraminelli, Iavor Bojinov et al., « The GenAI Wall Effect », Harvard Business School Working Paper No. 26-011, 2025.

- Evan F. Risko & Sam J. Gilbert, « Cognitive Offloading », Trends in Cognitive Sciences, vol. 20, n° 9, 2016.

- Hao-Ping Lee, Advait Sarkar, Lev Tankelevitch et al., « The Impact of Generative AI on Critical Thinking », Proceedings of the 2025 CHI Conference on Human Factors in Computing Systems, ACM, 2025.